Щоранку мільйони людей починають свій день з розмови. Але не з родиною чи друзями, а з маленьким пристроєм на столі. «Алексо, яка сьогодні погода?» або «Siri, постав будильник на 7:30». Ці фрази стали настільки звичними, що ми рідко замислюємося, яка магія відбувається за лаштунками. Як бездушний шматок пластику та металу розуміє наші слова, вловлює саркастичні нотки в голосі й виконує команди? Це не магія, а результат десятиліть наукових досліджень у галузі штучного інтелекту, і сьогодні ми зануримося у дивовижний світ технологій розпізнавання голосу. Це складна, багатогранна система, де поєднуються акустика, лінгвістика, комп’ютерні науки та машинне навчання, про це далі на iuzhhorod.com.

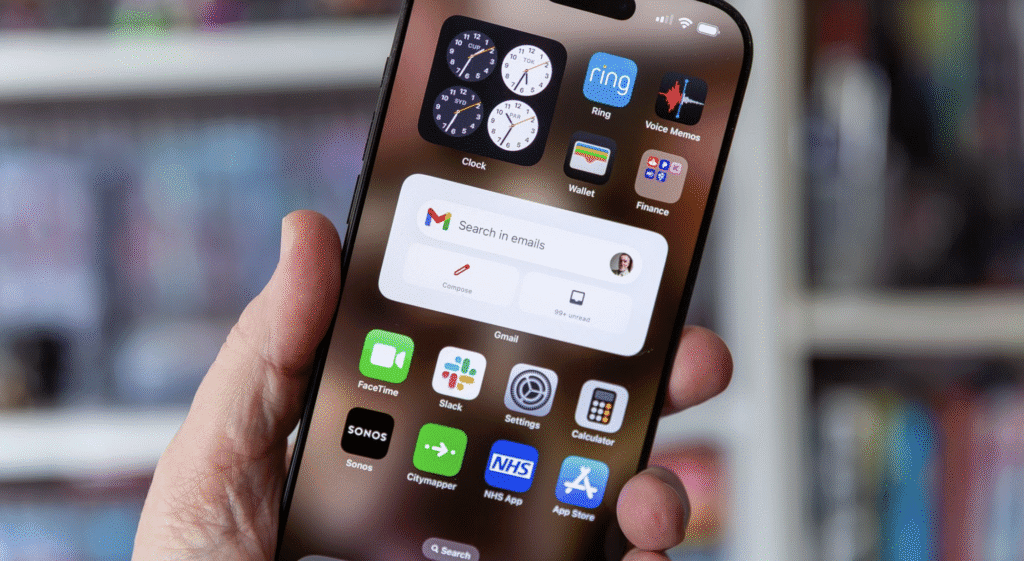

Від перших незграбних спроб у 1950-х роках до сучасних миттєвих та точних відповідей, голосові асистенти пройшли неймовірний шлях. Вони живуть у наших смартфонах, колонках, автомобілях і навіть холодильниках, стаючи невід’ємною частиною цифрового ландшафту. У цій статті ми детально розберемо, що саме відбувається в ту мить, коли ви вимовляєте заповітне слово-активатор, і як ваші звукові хвилі перетворюються на конкретну дію.

Крок 1: Пробудження гіганта. Як асистент починає слухати?

Перш ніж Siri чи Alexa зможуть виконати вашу команду, вони повинні зрозуміти, що ви звертаєтеся саме до них. Цей процес називається виявленням слова-активатора (wake word detection). Пристрої, оснащені голосовими асистентами, насправді постійно «слухають» оточення, але в дуже обмеженому, енергоефективному режимі. Вони не записують і не передають ваші розмови, а лише аналізують короткі фрагменти аудіопотоку на збіг із закладеним у пам’ять зразком — «Hey Siri», «Alexa», «OK Google».

Це схоже на те, як наш мозок у гамірній кімнаті ігнорує всі розмови, але миттєво реагує, коли хтось вимовляє наше ім’я. Для цього використовуються невеликі, оптимізовані моделі машинного навчання, що працюють безпосередньо на пристрої, без необхідності відправляти дані в хмару. Це забезпечує швидку реакцію та зберігає конфіденційність. Лише після того, як пристрій розпізнав слово-активатор, він починає повноцінний запис вашого запиту для подальшої обробки.

Крок 2: Від звуку до тексту. Магія автоматичного розпізнавання мовлення (ASR)

Коли ви сказали свою команду, пристрій записав її у вигляді аудіофайлу. Тепер починається найскладніше: перетворити цей набір звукових хвиль на зрозумілий комп’ютеру текст. Цю задачу виконує система автоматичного розпізнавання мовлення (Automatic Speech Recognition, ASR). Це ядро всієї технології, яке можна розбити на кілька етапів:

- Оцифрування звуку: Мікрофон вловлює звукові коливання вашого голосу і перетворює їх на цифровий сигнал.

- Виділення ознак: Програмне забезпечення очищує запис від фонового шуму (гавкіт собаки, шум вулиці) і розбиває його на найдрібніші звукові одиниці мови — фонеми. Наприклад, слово «привіт» складається з фонем [п], [р], [и], [в’], [і], [т].

- Акустичне моделювання: На цьому етапі система, навчена на величезних масивах даних людської мови (тисячі годин записів з різними акцентами, інтонаціями та темпами мовлення), порівнює отримані фонеми зі своєю бібліотекою. Вона визначає ймовірність, з якою певна послідовність звуків відповідає тій чи іншій фонемі.

- Мовне моделювання: Після того, як система отримала кілька ймовірних послідовностей фонем, вона повинна скласти з них осмислені слова та речення. Мовна модель аналізує, наскільки ймовірним є поєднання слів у даній мові. Наприклад, вона знає, що фраза «яка сьогодні погода» є значно ймовірнішою, ніж «яка согоні борода». Це допомагає виправити помилки акустичної моделі та вибрати найбільш правильний варіант тексту.

В результаті цього складного процесу на виході ми отримуємо текстове представлення вашого голосового запиту. Це вже великий крок, але для виконання команди цього недостатньо.

Крок 3: Розуміння суті. Сила обробки природної мови (NLP)

Отримати текст — це лише половина справи. Тепер системі потрібно зрозуміти, що цей текст означає і що ви від неї хочете. Тут у гру вступає обробка природної мови (Natural Language Processing, NLP) та її підрозділ — розуміння природної мови (Natural Language Understanding, NLU).

Завдання NLU — витягти з речення два ключових елементи:

- Намір (Intent): Чого саме хоче користувач? Яку дію він намагається виконати? Наприклад, у фразі «Постав пісню Queen — Bohemian Rhapsody» намір — це «відтворити музику».

- Сутності (Entities): Це специфічна інформація, яка уточнює намір. У нашому прикладі сутностями будуть «Queen» (виконавець) та «Bohemian Rhapsody» (назва пісні).

Розглянемо ще кілька прикладів:

| Запит користувача | Намір (Intent) | Сутності (Entities) |

|---|---|---|

| «Яка погода буде завтра в Ужгороді?» | Дізнатися погоду | Дата: завтра, Місце: Ужгород |

| «Нагадай мені зателефонувати мамі о 18:00» | Створити нагадування | Дія: зателефонувати мамі, Час: 18:00 |

| «Зменш яскравість екрану до 50%» | Змінити налаштування | Параметр: яскравість, Значення: 50% |

Для того, щоб так точно аналізувати речення, системи NLP використовують складні алгоритми, що враховують синтаксис (структуру речення) та семантику (значення слів та їх зв’язок). Вони здатні розуміти контекст, синоніми та навіть непрямі запити. Це дозволяє нам спілкуватися з асистентами природно, а не зазубреними командами. Ця ж технологія є ключовою і в інших сферах, наприклад, коли ми розглядаємо носимі технології (wearables), які також збирають та інтерпретують дані для нашої зручності.

Крок 4: Виконання команди та формування відповіді

Після того, як система зрозуміла ваш намір та виділила всі необхідні сутності, вона переходить до дії. Цей етап називається управлінням діалогом (Dialogue Management).

Залежно від запиту, система може:

- Звернутися до внутрішніх функцій пристрою: встановити будильник, змінити гучність, відкрити додаток.

- Виконати пошук в інтернеті: знайти відповідь на запитання, прочитати новини, надати інформацію з Вікіпедії.

- Взаємодіяти зі сторонніми сервісами (API): замовити таксі через Uber, увімкнути музику на Spotify, керувати пристроями «розумного» будинку.

- Запросити уточнення: Якщо в запиті не вистачає інформації (наприклад, «Постав нагадування», але не вказано про що і коли), асистент може поставити уточнююче запитання: «Про що вам нагадати і на який час?».

Коли дія виконана або інформація знайдена, система формує текстову відповідь. Наприклад: «Добре, я нагадаю вам зателефонувати мамі сьогодні о 18:00».

Крок 5: Від тексту до звуку. Синтез мовлення (TTS)

Останній етап — це знову перетворити текст на звук, щоб ви могли почути відповідь. Цим займається технологія синтезу мовлення (Text-to-Speech, TTS). Сучасні TTS-системи давно вийшли за межі монотонних роботизованих голосів. Завдяки нейронним мережам, вони генерують людську мову, яка звучить природно, з правильними інтонаціями, наголосами та паузами. Система аналізує текст, враховує знаки пунктуації та контекст, щоб відтворити емоційне забарвлення. Це робить взаємодію з асистентом більш комфортною та «живою».

Застосування технологій розпізнавання голосу за межами асистентів

Хоча Siri та Alexa є найвідомішими прикладами, технології розпізнавання голосу проникають у безліч інших сфер, кардинально змінюючи наш спосіб взаємодії зі світом:

- Медицина: Лікарі використовують диктування для швидкого заповнення медичних карток, що дозволяє їм приділяти більше уваги пацієнтам, а не паперам.

- Автомобільна промисловість: Водії можуть керувати навігацією, клімат-контролем та мультимедійною системою, не відриваючи рук від керма та очей від дороги, що значно підвищує безпеку.

- Освіта та доступність: Технології перетворення мови в текст допомагають студентам з вадами слуху стежити за лекціями, а людям з обмеженими фізичними можливостями — керувати комп’ютером та іншими пристроями. Це є частиною глобального тренду, де майбутнє освіти стає все більш інклюзивним та технологічним.

- Кол-центри та обслуговування клієнтів: Голосові боти можуть відповідати на типові запитання, маршрутизувати дзвінки та навіть аналізувати емоційний стан клієнта за його голосом.

- Юриспруденція: Автоматична транскрибація судових засідань та свідчень значно прискорює роботу юристів та стенографістів.

Виклики, проблеми та майбутнє голосових технологій

Незважаючи на вражаючий прогрес, технологія розпізнавання голосу все ще не ідеальна. Існують певні виклики, над якими інженери та вчені продовжують працювати:

- Точність у складних умовах: Акценти, діалекти, фоновий шум, одночасна розмова кількох людей — все це може значно знизити точність розпізнавання.

- Розуміння складного контексту: Системи все ще можуть плутатися в сарказмі, іронії, метафорах та складних багатозначних реченнях.

- Конфіденційність та безпека: Питання про те, хто, як і для чого використовує записи наших голосів, залишається одним із найгостріших. Хоча компанії запевняють, що дані використовуються лише для покращення сервісів, ризики витоків та зловживань завжди існують.

Майбутнє голосових інтерфейсів виглядає захоплюючим. Ми рухаємося до ще більш безшовної та природної взаємодії. Очікується, що асистенти стануть проактивними — вони будуть передбачати наші потреби на основі звичок та контексту. Розвиток технологій дозволить їм вести більш складні, тривалі діалоги, розуміти емоції та навіть ідентифікувати людину за унікальними характеристиками її голосу (голосова біометрія) для підвищення безпеки.

Висновок

За простим запитом «Siri, яка погода?» стоїть колосальний технологічний ланцюжок: від виявлення слова-активатора на вашому пристрої до складної обробки даних у потужних хмарних серверах за допомогою нейронних мереж. Це дивовижне поєднання акустики, лінгвістики та штучного інтелекту, яке робить наше життя трішки простішим та зручнішим. І хоча попереду ще багато викликів, одне можна сказати напевно: у майбутньому ми будемо спілкуватися з технологіями все більше і більше, і цей діалог буде ставати все більш людяним.